Você já parou para pensar se os sistemas digitais decidem seu futuro com base em preconceitos ocultos? Atualmente, a inteligência artificial molda a sociedade moderna de formas profundas. Ela oferece soluções incríveis para problemas cotidianos.

Muitos setores adotam tal tecnologia visando produtividade máxima. Entretanto, o uso de ferramentas digitais exige responsabilidade constante. Sem supervisão, dados viciados alimentam algoritmos que perpetuam injustiças sociais graves.

Promover a ia e transparência torna-se essencial ao progresso humano. Devemos buscar sistemas que respeitem a diversidade de cada indivíduo. A inclusão digital deve ser prioridade absoluta para desenvolvedores profissionais.

Ao adotar práticas éticas, criamos um ambiente seguro. Isso permite aproveitar o potencial máximo das inovações sem ferir direitos fundamentais. O equilíbrio entre código e humanidade define nosso sucesso futuro.

Principais Conclusões

- Identificar vieses em sistemas algorítmicos.

- Importância da curadoria cuidadosa de dados.

- Desenvolvimento de códigos com base ética.

- Vantagens da automação inclusiva para empresas.

- Estratégias contra preconceitos no meio digital.

- Transparência total nos modelos preditivos usados.

- Governança para garantir sistemas justos.

1. O Desafio da Equidade na Era Digital

A era digital trouxe consigo avanços tecnológicos sem precedentes, mas também desafios complexos relacionados à equidade. A inteligência artificial (IA) está cada vez mais presente em nossas vidas, influenciando desde decisões financeiras até interações sociais. No entanto, a forma como esses sistemas são desenvolvidos e implementados pode perpetuar ou mitigar as desigualdades existentes.

A necessidade de equidade nos sistemas de IA é crucial. Quando os algoritmos são treinados com dados que refletem preconceitos históricos ou sociais, eles podem reforçar estereótipos e práticas discriminatórias. Por outro lado, a IA também pode ser uma ferramenta poderosa para promover a justiça e a igualdade, desde que seja desenvolvida e utilizada de maneira ética e responsável.

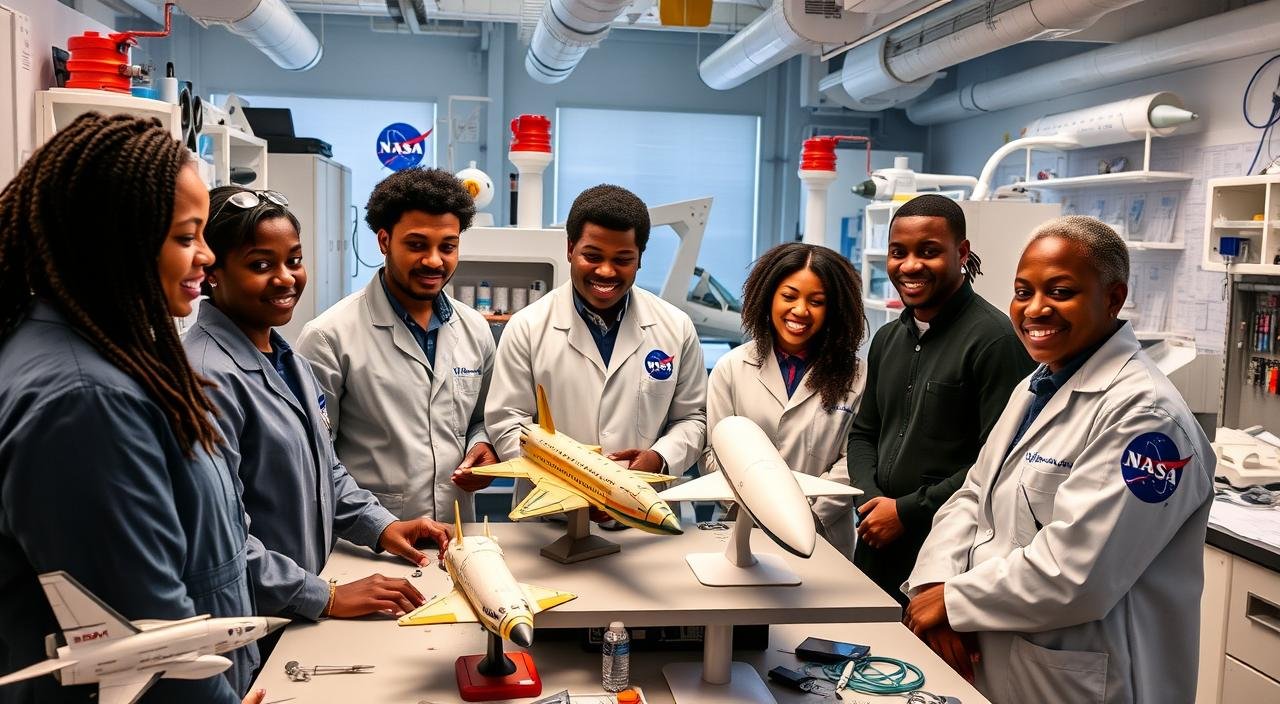

A diversidade nas equipes de desenvolvimento é um fator chave para criar sistemas de IA mais justos. Equipes diversificadas trazem perspectivas variadas, ajudando a identificar e mitigar vieses que poderiam passar despercebidos. Além disso, a inovação em IA deve ser acompanhada de uma reflexão ética profunda, garantindo que os benefícios sejam distribuídos de forma equitativa.

A implementação de práticas de IA responsável inclui a auditoria regular de algoritmos e dados, além da transparência sobre como as decisões são tomadas. Isso não apenas ajuda a prevenir o racismo algorítmico, mas também constrói confiança nas tecnologias emergentes.

Em resumo, o desafio da equidade na era digital é multifacetado e requer uma abordagem holística. Ao promover a ética e a responsabilidade no desenvolvimento da IA, podemos criar um futuro mais justo e inclusivo para todos.

2. O Que É Racismo Algorítmico e Por Que Ele Existe

Com a crescente dependência de sistemas de IA, entender o racismo algorítmico é crucial para mitigar seus efeitos negativos. O racismo algorítmico refere-se à discriminação racial perpetuada por algoritmos utilizados em sistemas de Inteligência Artificial (IA). Esses sistemas, projetados para tomar decisões automatizadas, podem refletir e amplificar preconceitos existentes na sociedade.

2.1. Definição de Racismo Algorítmico

O racismo algorítmico ocorre quando sistemas de IA são treinados com dados que contêm vieses raciais, resultando em decisões discriminatórias. Isso pode acontecer em diversas áreas, como reconhecimento facial, sistemas de justiça criminal e processos de recrutamento.

- Viés nos dados de treinamento

- Desenvolvimento de algoritmos sem considerar a diversidade

- Falta de testes com grupos diversos

2.2. As Raízes do Preconceito em Sistemas de IA

As raízes do preconceito em sistemas de IA estão frequentemente relacionadas aos dados utilizados para treinar esses sistemas. Se os dados refletem desigualdades históricas e sociais, os algoritmos resultantes podem perpetuar essas desigualdades. Além disso, a falta de diversidade nas equipes de desenvolvimento pode contribuir para a omissão de perspectivas importantes.

A justiça algorítmica busca abordar esses problemas, promovendo a equidade nos sistemas de IA. Isso envolve não apenas a identificação de vieses, mas também a implementação de práticas que mitiguem esses vieses.

2.3. A Diferença Entre Viés Implícito e Discriminação Sistêmica

É importante distinguir entre viés implícito e discriminação sistêmica. O viés implícito refere-se a atitudes ou estereótipos inconscientes que afetam as decisões. Já a discriminação sistêmica é resultado de políticas e práticas institucionais que perpetuam a desigualdade.

Ambos os conceitos são relevantes para entender o racismo algorítmico, pois os sistemas de IA podem refletir tanto vieses implícitos quanto discriminação sistêmica. Portanto, abordagens para mitigar o racismo algorítmico devem considerar esses dois aspectos.

3. Manifestações do Racismo Algorítmico na Sociedade

As manifestações do racismo algorítmico são multifacetadas e impactam várias esferas da sociedade. A inteligência artificial e a tecnologia avançada têm sido fundamentais em diversas áreas, mas também podem perpetuar desigualdades raciais.

3.1. Reconhecimento Facial e Viés Racial

O reconhecimento facial é uma das áreas onde o racismo algorítmico se manifesta de forma evidente. Estudos têm demonstrado que muitos sistemas de reconhecimento facial apresentam viés racial, identificando erroneamente indivíduos de grupos raciais minoritários.

- Sistemas de reconhecimento facial frequentemente falham em identificar corretamente indivíduos negros e hispânicos.

- A precisão desses sistemas varia significativamente entre diferentes grupos raciais.

- O viés nos dados de treinamento é uma das principais causas desses problemas.

3.2. Sistemas de Justiça Criminal e Decisões Automatizadas

Os sistemas de justiça criminal também são afetados pelo racismo algorítmico. Algoritmos usados para prever a probabilidade de reincidência criminal têm sido criticados por perpetuar vieses raciais.

- Algoritmos de previsão de reincidência frequentemente classificam incorretamente réus negros como de alto risco.

- Esses vieses podem levar a decisões injustas e aumentar a disparidade racial no sistema de justiça.

- A falta de transparência nos algoritmos dificulta a identificação e correção desses vieses.

3.3. Processos de Recrutamento e Seleção

Os processos de recrutamento e seleção também podem ser influenciados pelo racismo algorítmico. Ferramentas de tecnologia usadas para filtrar currículos e selecionar candidatos podem perpetuar desigualdades.

- Ferramentas de recrutamento automatizado podem excluir candidatos de grupos sub-representados.

- A falta de diversidade nos dados de treinamento pode levar a vieses nos critérios de seleção.

- É crucial auditar e ajustar esses sistemas para garantir a equidade.

4. Casos Reais de Discriminação Algorítmica

A inteligência artificial (IA) pode perpetuar preconceitos existentes se não for desenvolvida com cuidado. Isso ocorre porque os algoritmos aprendem com os dados que lhes são fornecidos, e se esses dados refletem vieses históricos ou sociais, o sistema de IA pode acabar replicando esses vieses.

Um dos casos mais notórios de discriminação algorítmica ocorreu em sistemas de reconhecimento facial, que demonstraram ser menos precisos ao identificar indivíduos de pele mais escura ou mulheres. Isso levanta preocupações éticas significativas sobre o uso desses sistemas em contextos como segurança pública e controle de fronteiras.

4.1. Exemplos Documentados em Empresas de Tecnologia

Várias empresas de tecnologia têm enfrentado críticas por desenvolverem sistemas de IA que discriminam certos grupos. Por exemplo, um estudo revelou que um sistema de recrutamento automatizado utilizado por uma grande empresa de tecnologia tendia a rejeitar candidaturas de mulheres para cargos técnicos, pois o algoritmo foi treinado com dados históricos que refletiam um viés contra mulheres nessas posições.

Outro caso notável envolveu um sistema de análise de crédito que foi considerado discriminatório contra comunidades de baixa renda. O algoritmo utilizava variáveis que indiretamente refletiam a situação socioeconômica dos candidatos, resultando em decisões de crédito que desfavoreciam esses grupos.

4.2. Impactos Sociais e Econômicos nas Comunidades Afetadas

A discriminação algorítmica pode ter impactos profundos nas comunidades afetadas, exacerbando desigualdades existentes. Por exemplo, sistemas de justiça criminal que utilizam algoritmos para prever a probabilidade de reincidência têm sido criticados por viés racial, levando a decisões judiciais que desproporcionalmente afetam minorias étnicas.

Além disso, a discriminação algorítmica em processos de recrutamento pode limitar as oportunidades de emprego para grupos historicamente marginalizados, perpetuando ciclos de pobreza e exclusão social.

É crucial que as empresas e os desenvolvedores de IA tomem medidas para prevenir a discriminação algorítmica, garantindo que seus sistemas sejam justos, transparentes e auditáveis. Isso inclui a implementação de práticas de IA responsável e a diversificação das equipes de desenvolvimento para trazer perspectivas mais amplas e inclusivas.

5. IA e Raça: Entendendo a Relação Complexa

A relação entre inteligência artificial e raça é complexa e multifacetada, envolvendo questões éticas, sociais e técnicas. A forma como os sistemas de IA são projetados e treinados pode perpetuar ou mitigar as desigualdades raciais existentes.

Como os Dados Refletem Desigualdades Históricas

Os dados utilizados para treinar sistemas de IA frequentemente refletem as desigualdades históricas e sociais presentes na sociedade. Isso significa que, se os dados de treinamento contêm vieses raciais, os modelos de IA resultantes provavelmente irão perpetuar esses vieses.

Por exemplo, se um conjunto de dados utilizado para treinar um sistema de reconhecimento facial é composto principalmente por imagens de pessoas de uma determinada raça, o sistema pode ter dificuldade em reconhecer com precisão indivíduos de outras raças. Isso pode levar a resultados discriminatórios em aplicações como segurança, vigilância e justiça criminal.

| Tipo de Viés | Descrição | Impacto |

|---|---|---|

| Viés de Seleção | Ocorre quando os dados de treinamento não são representativos da população que o sistema irá encontrar. | Resultados imprecisos ou discriminatórios para grupos sub-representados. |

| Viés de Confirmação | Acontece quando os dados de treinamento refletem preconceitos existentes, reforçando estereótipos. | Perpetuação de desigualdades e discriminação. |

O Papel dos Desenvolvedores e da Diversidade nas Equipes

A diversidade nas equipes de desenvolvimento de IA é crucial para identificar e mitigar vieses raciais nos sistemas de IA. Equipes diversificadas trazem perspectivas variadas, ajudando a garantir que os sistemas sejam projetados para atender a uma ampla gama de usuários.

Desenvolvedores de diferentes origens podem identificar vieses potenciais que outros poderiam perder, contribuindo para a criação de sistemas mais justos e inclusivos.

Reprodução de Estereótipos em Modelos de Linguagem

Modelos de linguagem treinados em grandes conjuntos de dados podem reproduzir estereótipos raciais presentes nesses dados. Isso pode resultar em respostas ou conteúdos gerados que são ofensivos ou discriminatórios.

Para evitar isso, é importante monitorar e testar os modelos de linguagem para vieses raciais, além de implementar estratégias para mitigá-los, como a diversificação dos dados de treinamento e a inclusão de mecanismos de feedback dos usuários.

6. Causas Técnicas do Viés Algorítmico

A análise das causas técnicas do viés algorítmico é crucial para desenvolver soluções eficazes. Os algoritmos são tão bons quanto os dados que os alimentam e as suposições embutidas neles.

Um dos principais fatores que contribuem para o viés algorítmico é a qualidade e representatividade dos dados utilizados para treinar os modelos de IA.

6.1. Dados de Treinamento Não Representativos

Os dados de treinamento não representativos são uma das principais causas do viés algorítmico. Se os dados utilizados para treinar um modelo de IA não refletem a diversidade da população que ele irá atender, o modelo pode aprender a discriminar certos grupos.

Exemplo: Um sistema de reconhecimento facial treinado principalmente com imagens de pessoas de pele clara pode ter dificuldade em reconhecer indivíduos com tons de pele mais escuros.

6.2. Variáveis Proxy e Discriminação Indireta

Variáveis proxy são características ou atributos que, embora não sejam diretamente relacionados à variável de interesse, podem estar correlacionados com ela de maneira que introduzem viés.

Por exemplo, um modelo de crédito que usa o código postal como uma variável pode inadvertidamente discriminar comunidades de baixa renda ou minorias, pois essas áreas tendem a ter códigos postais específicos.

6.3. Falta de Testes com Grupos Diversos

A falta de testes rigorosos com grupos diversos durante a fase de desenvolvimento de um sistema de IA pode levar a vieses não detectados.

“Testar sistemas de IA com uma variedade de dados e cenários é fundamental para garantir que eles funcionem de forma justa e precisa para todos os usuários.”

6.4. Otimização para Métricas Inadequadas

A otimização de algoritmos para métricas inadequadas pode resultar em sistemas que, embora otimizados para certos critérios, perpetuam ou até ampliam o viés.

É crucial que os desenvolvedores considerem métricas que promovam a equidade e a justiça, além da eficiência ou precisão.

7. Estratégias para Prevenir o Racismo Algorítmico

A luta contra o racismo algorítmico exige uma abordagem multifacetada que envolva auditoria de dados, diversificação de equipes e transparência. Para garantir que os sistemas de IA sejam justos e não perpetuem desigualdades, é fundamental adotar estratégias eficazes.

7.1. Auditoria de Dados e Algoritmos

A auditoria de dados e algoritmos é uma etapa crucial para identificar e mitigar vieses. Isso envolve examinar os dados utilizados para treinar os modelos de IA e avaliar se eles são representativos da diversidade da população.

Um exemplo de auditoria eficaz é a análise de viés em sistemas de reconhecimento facial. Estudos mostraram que muitos desses sistemas têm vieses raciais significativos, levando a falsos positivos ou negativos desproporcionais em certos grupos raciais.

7.2. Implementação de Práticas de IA Responsável

A implementação de práticas de IA responsável é vital para prevenir o racismo algorítmico. Isso inclui o desenvolvimento de diretrizes éticas para o desenvolvimento de IA, garantindo que os sistemas sejam transparentes e explicáveis.

“A transparência nos processos de tomada de decisão algorítmica é essencial para construir confiança e garantir que os sistemas sejam justos e responsáveis.”

7.3. Diversificação de Equipes de Desenvolvimento

A diversificação das equipes de desenvolvimento é outra estratégia chave. Equipes diversas trazem perspectivas variadas, o que pode ajudar a identificar e mitigar vieses nos sistemas de IA, promovendo a justiça algorítmica.

| Benefícios da Diversidade | Impacto nos Sistemas de IA |

|---|---|

| Perspectivas variadas | Melhoria na identificação de vieses |

| Inovação | Desenvolvimento de soluções mais criativas e inclusivas |

| Representatividade | Sistemas de IA mais justos e representativos da população |

7.4. Transparência e Explicabilidade dos Sistemas

A transparência e explicabilidade dos sistemas de IA são fundamentais para a confiança e a responsabilidade. Isso envolve fornecer informações claras sobre como os sistemas tomam decisões, garantindo diversidade e inclusão.

Ao adotar essas estratégias, podemos prevenir o racismo algorítmico e garantir que os sistemas de IA sejam justos, éticos e benéficos para todos.

8. Como Usar a Inteligência Artificial de Forma Ética e Inclusiva

Para garantir que a IA seja uma ferramenta de progresso e não de discriminação, é fundamental adotá-la de forma ética e inclusiva. Isso envolve uma abordagem multifacetada que considera as implicações sociais, culturais e econômicas das tecnologias de IA.

Princípios de Justiça Algorítmica

A justiça algorítmica é um conceito central na implementação ética da IA. Isso implica garantir que os algoritmos sejam projetados e treinados para evitar vieses e discriminações. Alguns princípios chave incluem:

- Transparência nos processos de tomada de decisão;

- Responsabilidade pelas ações e resultados dos sistemas de IA;

- Equidade na distribuição de benefícios e riscos.

Frameworks e Ferramentas para IA Ética

Diversos frameworks e ferramentas têm sido desenvolvidos para ajudar a garantir a ética na IA. Isso inclui:

- Guias de melhores práticas para o desenvolvimento de IA;

- Ferramentas de auditoria para detectar vieses nos algoritmos;

- Plataformas de colaboração para promover a transparência e a responsabilidade.

Monitoramento Contínuo de Resultados

O monitoramento contínuo dos resultados dos sistemas de IA é crucial para identificar e corrigir problemas éticos à medida que surgem. Isso envolve:

- Acompanhamento regular dos desempenhos dos algoritmos;

- Análise de feedback de usuários e partes interessadas;

- Ajustes contínuos para melhorar a equidade e a justiça.

Envolvimento de Comunidades Afetadas no Processo

O envolvimento das comunidades afetadas é fundamental para o desenvolvimento de soluções de IA éticas e inclusivas. Isso pode ser alcançado por meio de:

- Consultas públicas e diálogos comunitários;

- Parcerias com organizações que representam grupos vulneráveis;

- Incorporação de perspectivas diversas no processo de desenvolvimento.

Ao seguir esses princípios e práticas, é possível utilizar a inteligência artificial de forma ética e inclusiva, promovendo a inovação e minimizando os riscos de racismo algorítmico.

9. Benefícios da IA Quando Desenvolvida com Diversidade

A IA desenvolvida com diversidade oferece vantagens significativas em termos de inovação e resultados. Ao incorporar diversas perspectivas e experiências, as equipes de desenvolvimento podem criar sistemas de IA mais robustos e eficazes.

Inovação Através de Perspectivas Múltiplas

A diversidade nas equipes de desenvolvimento de IA fomenta a inovação. Quando pessoas de diferentes origens, culturas e experiências trabalham juntas, elas trazem ideias únicas e abordagens variadas para resolver problemas complexos.

Isso resulta em soluções de IA mais criativas e adaptáveis às necessidades de uma ampla gama de usuários. Além disso, a diversidade ajuda a evitar o pensamento de grupo e a promover uma cultura de questionamento e melhoria contínua.

Melhores Resultados para Todos os Usuários

Sistemas de IA desenvolvidos com diversidade tendem a ser mais inclusivos e a oferecer melhores resultados para uma ampla gama de usuários. Isso ocorre porque as equipes diversas são mais propensas a considerar diferentes cenários e necessidades durante o processo de desenvolvimento.

Como resultado, os sistemas de IA são mais capazes de atender às necessidades de usuários de diversas origens e habilidades, promovendo a equidade e a justiça.

| Benefícios da Diversidade em IA | Descrição | Impacto |

|---|---|---|

| Inovação | Perspectivas múltiplas levam a soluções criativas | Sistemas de IA mais robustos e adaptáveis |

| Inclusão | Desenvolvimento considerando diversas necessidades | Melhores resultados para uma ampla gama de usuários |

| Vantagem Competitiva | Diferenciação através da diversidade e inclusão | Reputação positiva e liderança no mercado |

Vantagem Competitiva e Reputacional

Empresas que desenvolvem IA com diversidade não apenas criam sistemas mais eficazes, mas também ganham uma vantagem competitiva e reputacional. A capacidade de oferecer soluções inclusivas e inovadoras é altamente valorizada pelos consumidores e parceiros de negócios.

Além disso, a transparência e o compromisso com a diversidade e a inclusão podem melhorar significativamente a reputação de uma empresa, tornando-a mais atraente para talentos e investidores.

10. Conclusão

A inteligência artificial tem o potencial de revolucionar diversas áreas da sociedade, mas também pode perpetuar e amplificar preconceitos existentes se não for desenvolvida com cuidado. O racismo algorítmico é um desafio significativo que precisa ser enfrentado por meio da promoção da justiça algorítmica e da ética na IA.

Ao longo deste artigo, discutimos as causas e manifestações do viés algorítmico, bem como estratégias para preveni-lo. É fundamental que os desenvolvedores de IA priorizem a diversidade e a inclusão em suas equipes, além de implementar práticas de auditoria e monitoramento contínuo.

Ao promover a ética e a justiça algorítmica, podemos garantir que a inteligência artificial seja uma ferramenta para o bem-estar de todos, e não um mecanismo de perpetuação de desigualdades. Isso requer um compromisso contínuo com a transparência, explicabilidade e responsabilidade no desenvolvimento de sistemas de IA.